AI Overviews : les enseignements de Google 1 an après

Il y a un an, Google lançait AI Overviews, une fonctionnalité d’IA générative destinée à…

Sommaire

L’intelligence artificielle (IA) est en passe de devenir un outil du quotidien pour beaucoup d’entreprises en 2024. Et pour cause : gain de productivité des équipes, booste de la créativité, personnalisation de l’expérience client, meilleur positionnement SEO, réduction des coûts… Les intérêts d’opter pour l’IA sont multiples !

Dans cet article, découvrez les 10 termes clés à maîtriser pour comprendre le fonctionnement des IA génératives.

L’intelligence artificielle générative est un type d’intelligence artificielle qui permet de générer différents formats de contenu :

Les IA génératives utilisent des méthodes d’apprentissage automatique pour apprendre à partir de grandes quantités d’informations, puis utiliser cette connaissance pour produire un nouveau contenu.

À retenir :

Les IA génératives ne cherchent donc pas un contenu existant dans une base de données : elles le créent de toute pièce, à la demande, et de manière quasi instantanée !

Les IA génératives ne cherchent donc pas un contenu existant dans une base de données : elles le créent de toute pièce, à la demande, et de manière quasi instantanée !

Le but des IA génératives est ainsi de réaliser une tâche qui requière une certaine “intelligence”, ordinairement effectuée par les humains. Autrement dit, l’IA générative vise à reproduire artificiellement la créativité et les compétences humaines. On peut donc leur confier la création d’un design, la rédaction d’un texte, un montage vidéo…

L’intelligence artificielle multimodale est une approche qui vise à développer des systèmes capables de comprendre et de traiter simultanément plusieurs formats d’informations, tels que le texte, l’image et l’audio. Contrairement aux systèmes unimodaux qui se concentrent sur un seul format, l’IA multimodale cherche à tirer parti de différents types de sources pour arriver à une compréhension plus holistique.

Ces systèmes utilisent souvent des modèles d’apprentissage profond pour traiter de manière cohérente des informations hétérogènes.

Par exemple, l’IA multimodale peut être utilisée pour comprendre le sens d’une conversation entre deux individus en tenant compte de leur langage, mais aussi de leurs gestes. On peut envisager l’intelligence artificielle multimodale dans tout scénario complexe qui nécessite la prise en compte de plusieurs formats de données.

Un modèle de langage est un système informatique entraîné sur de vastes ensembles de données textuelles afin d’apprendre les structures, les règles grammaticales et les relations sémantiques de notre langage.

Les modèles de langage génératifs sont particulièrement puissants, puisqu’ils peuvent créer du texte de manière contextuelle en prenant en compte le contexte précédent des mots ou des phrases dans une séquence. Les utilisateurs interagissent avec ces modèles en fournissant une instruction appelée “prompt”, guidant ainsi la génération du texte.

À retenir :

Les modèles de langage sont la base du fonctionnement des IA qui permettent de générer du texte. Ces IA sont massivement utilisées par les professionnels et les particuliers pour la rédaction automatisée de contenu ou encore la traduction automatique.

Les modèles de langage sont la base du fonctionnement des IA qui permettent de générer du texte. Ces IA sont massivement utilisées par les professionnels et les particuliers pour la rédaction automatisée de contenu ou encore la traduction automatique.

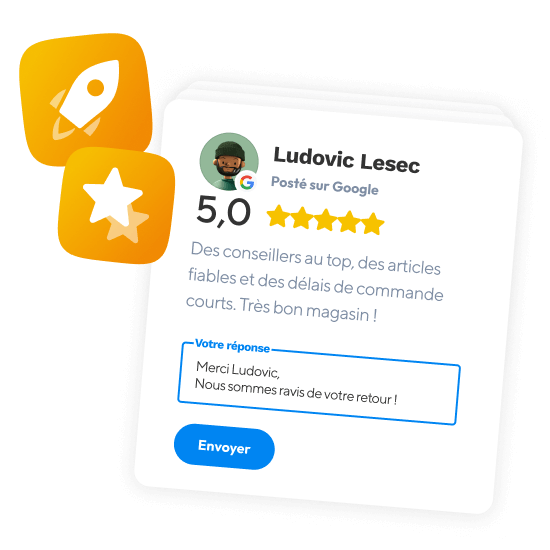

Partoo intègre l’IA dans la réponse aux avis clients

L’assistant IA permet aux entreprises de générer des suggestions de réponses à leurs avis clients avec l’intelligence artificielle :

Dans le contexte de l’IA générative, un « prompt » désigne une instruction ou une série de mots clés fournis à un modèle de langage pour guider la génération de contenu. Il s’agit d’une directive donnée à l’IA afin de l’orienter dans la réponse à la requête.

Les prompts peuvent varier en complexité, allant de simples phrases à des descriptions détaillées, influençant ainsi le ton, le style et le contenu du résultat généré. La qualité et la pertinence du prompt jouent un rôle crucial dans la capacité de l’IA à produire des réponses cohérentes et adaptées aux attentes de l’utilisateur.

Le saviez-vous ?

Les utilisateurs peuvent très bien enchaîner différents prompts pour obtenir des résultats variés et affiner ainsi les sorties générées par le modèle de langage !

Les utilisateurs peuvent très bien enchaîner différents prompts pour obtenir des résultats variés et affiner ainsi les sorties générées par le modèle de langage !

Une donnée d’entraînement est une information utilisée pour entraîner un modèle de langage. Ces données consistent généralement en un vaste ensemble de textes provenant de diverses sources, permettant au modèle d’apprendre les règles linguistiques, la sémantique et les nuances du langage naturel.

Les données d’entraînement sont cruciales : elles permettent au modèle d’acquérir une compréhension approfondie du langage, lui permettant ainsi de générer du texte de manière contextuellement pertinente lorsqu’il est confronté à des instructions ou des prompts ultérieurs.

La qualité et la diversité des données d’entraînement influent directement les performances du modèle : ainsi, un ensemble de données bien choisi contribue à améliorer la capacité du modèle à produire des résultats précis et adaptés aux besoins spécifiques de l’utilisateur.

Vous aimerez aussi :

4 manières de développer votre référencement local grâce à l’intelligence artificielle

Un LLM, ou « Large Langage Model », désigne généralement un modèle de langage pré-entraîné particulièrement vaste et complexe.

Ces modèles sont capables de comprendre et de générer du langage naturel avec une sophistication accrue. Les LLM sont entraînés sur d’immenses ensembles de données textuelles, ce qui leur permet de capturer des mécanismes subtils du langage et de produire des résultats très pertinents.

Le saviez-vous ?

GPT, ou « Generative Pre-trained Transformer, » désigne une famille de LLM développée par la société OpenAI. Google dispose également de son LLM, appelé Gemini.

GPT, ou « Generative Pre-trained Transformer, » désigne une famille de LLM développée par la société OpenAI. Google dispose également de son LLM, appelé Gemini.

La principale différence entre l’apprentissage supervisé ou non supervisé des LLM réside dans la manière dont les modèles sont entraînés. L’apprentissage supervisé implique que le modèle de langage a reçu, lors de sa phase d’apprentissage, des exemples de textes en entrée associés à des textes de sortie correspondants.

À l’inverse, l’apprentissage non supervisé consiste à exposer le modèle à des données non associées avec d’autres. Cette approche permet au modèle d’apprendre des caractéristiques inhérentes au langage sans avoir de correspondance explicite entre les entrées et les sorties, favorisant une génération autonome et plus créative de texte.

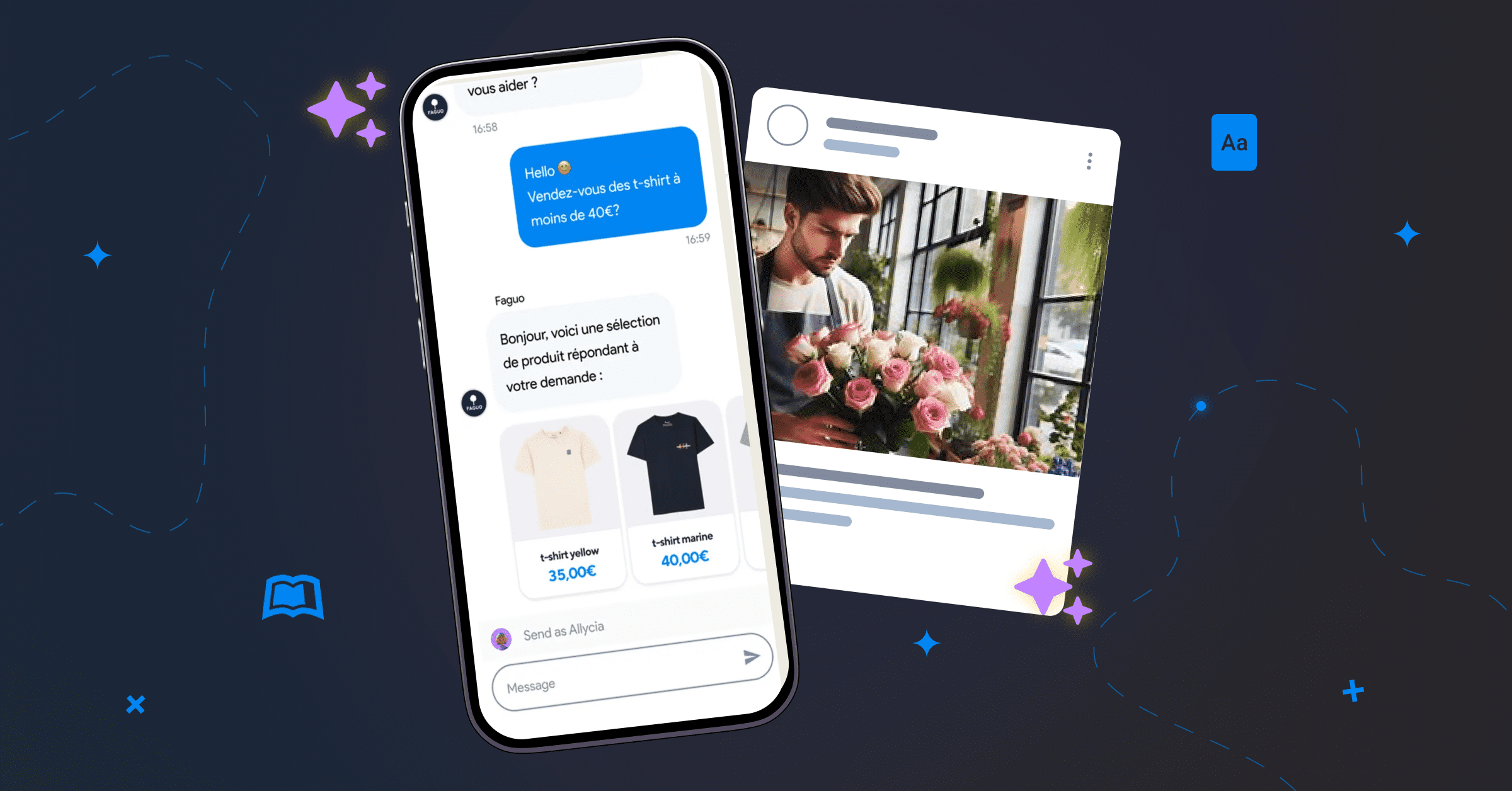

Les agents conversationnels, également appelés “chatbot”, sont des programmes informatiques conçus pour discuter avec les utilisateurs. Ces agents conversationnels utilisent des LLM pour comprendre les requêtes des utilisateurs et leur répondre de manière naturelle. Ils sont entraînés sur de grands ensembles de données pour acquérir une compréhension fine du langage, ce qui leur permet de tenir des conversations fluides et de proposer des réponses pertinentes.

Les agents conversationnels permettent aux IA génératives de s’intégrer à diverses plateformes (site Internet des entreprises, CRM…), où leur capacité à imiter les interactions humaines offre une expérience utilisateur améliorée.

LLM ou agent conversationnel ?

GPT est un LLM, tandis que ChatGPT est son agent conversationnel. De la même manière, le LLM de Google, Gemini, dispose de son agent conversationnel, Bard.

GPT est un LLM, tandis que ChatGPT est son agent conversationnel. De la même manière, le LLM de Google, Gemini, dispose de son agent conversationnel, Bard.

Le machine learning, ou apprentissage automatique, est une approche fondamentale qui permet aux modèles de langage de s’améliorer et de générer du texte de manière autonome. Ce système permet aux modèles de langage “d’apprendre” par eux-mêmes grâce aux données auxquelles ils ont accès.

Autrement dit, les modèles de langage agissent comme de faux cerveaux qui développent leur sagacité grâce à leurs propres connaissances. Ce ne sont pas de simples algorithmes qui réalisent des tâches grâce à une programmation explicite.

À retenir :

C’est parce qu’elles sont capables d’apprendre toutes seules grâce au machine learning que les IA génératives méritent leur nom “d’intelligences artificielles” !

C’est parce qu’elles sont capables d’apprendre toutes seules grâce au machine learning que les IA génératives méritent leur nom “d’intelligences artificielles” !

Sous-discipline du machine learning, le deep learning implique l’utilisation de réseaux neuronaux profonds pour résoudre des problèmes complexes. Les modèles de langage populaires comme GPT ou Gemini font appel au deep learning.

Ces réseaux neuronaux profonds sont capables d’apprendre des représentations complexes des données textuelles. L’utilisation de multiples couches dans ces réseaux permet une compréhension hiérarchique des structures du langage, améliorant ainsi la capacité du modèle à capturer des relations subtiles et contextuelles dans les séquences de texte.

En exploitant cette profondeur, le deep learning contribue à la puissance et à la complexité des modèles de langage génératifs.

Développer facilement votre activité avec Internet ? C’est possible grâce à Partoo !

Notre outil gratuit analyse votre fiche d’établissement Google et vous donne des conseils d’optimisation personnalisés !

Nos meilleurs articles et guides pratiques dans votre boîte mail une fois par mois